En 1968, dans un roman qui allait fournir la trame du film Blade Runner, l’écrivain Philip K. Dick se demandait si les robots deviendraient un jour suffisamment évolués pour avoir besoin de rêver. Aujourd’hui, dans son laboratoire, l’U2IS d’ENSTA Paris, Gianni Franchi voudrait que l’intelligence artificielle apprenne à douter de ses certitudes.

Dans un article récemment accepté dans le cadre de la 11e Conférence internationale sur les représentations d'apprentissage (ICLR, du 1er au 5 mai 2023), Gianni Franchi a mis en évidence la déraisonnable certitude des réseaux de neurones artificiels lorsqu’on leur demande d’évaluer la pertinence de leurs résultats, et envisagé différentes pistes pour y remédier.

« Prenons le cas d’un réseau de neurones entraîné à reconnaître des animaux : chats, chiens, oiseaux, il est imbattable. Mais il ne sait faire que ça. Si jamais on lui présente une image de voiture, il y a de fortes chances pour qu’il dise que c’est un chien, car c’est l’espèce qui a la plus grande variabilité morphologique intrinsèque. Pour le réseau, la voiture sera un nouveau type de chien, avec des pattes rondes. Et lorsqu’on lui demandera la confiance qu’il accorde à ce classement, il donnera un score de 90% ! »

Cette anecdote met en lumière le fait que les réseaux de neurones sont pour le moment incapables de modéliser les limites de leur connaissance. Si l’exemple précédent fait sourire, il soulève un problème qui pourrait être beaucoup plus grave dans un autre contexte.

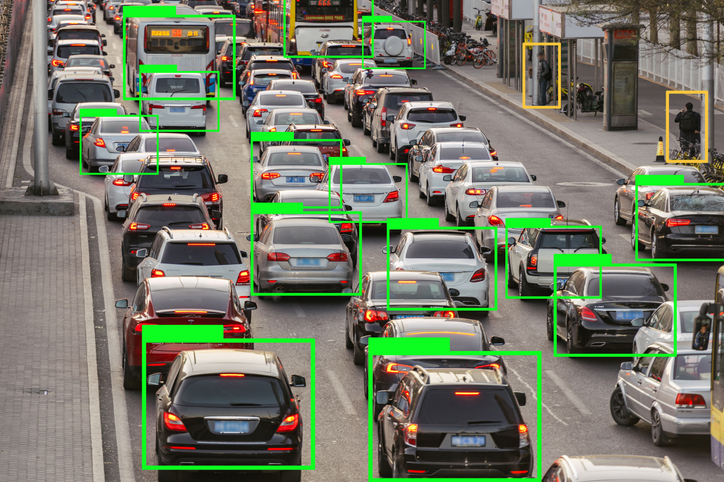

« Imaginez à présent la situation inverse : ce même réseau de neurones entraîné à reconnaître des panneaux routiers, des voitures et des obstacles courants, et installé à bord d’un véhicule autonome. Surgit un sanglier au détour d’une route de campagne, une classe d’objet qu’il n’a jamais vue. Le risque est grand qu’il ne l’interprète ni comme un arbre, ni comme un piéton, et laisse le véhicule poursuivre son chemin vers cet objet qui n’entre pas dans ses catégories, et n’existe donc pas pour lui. »

Pour remédier à cette gestion défaillante de l’incertitude, des pistes de recherche existent. « La plus prometteuse est celle des techniques ensemblistes » confie Gianni Franchi. « Elles consistent à utiliser plusieurs réseaux de neurones experts en parallèle, et à vérifier qu’ils font consensus dans leurs résultats. Mais leur mise en pratique soulève de nombreuses difficultés liées aux subtilités de la théorie de l’information. »

Autre inconvénient de cette approche, son coût, prohibitif, car il faut entraîner simultanément de nombreux réseaux de neurones experts.

« Avec quelques étudiants, et c’est l’expérience que je décrirai lors de la conférence d’ICLR, je suis parvenu à entraîner des réseaux beaucoup plus simples, constitués de moins de neurones, mais qui permettent d’approximer un réseau beaucoup plus gros. Quand on regarde l’ensemble des prédictions de tous ces petits réseaux, leurs prédictions s’avèrent de qualité tout à fait comparable à celles de réseaux beaucoup plus gros. Il serait très avantageux de les utiliser dans le cas des véhicules autonomes, où il y a beaucoup de données à analyser tout en disposant de moyens de calcul limités. »

Bien sûr, l’idéal serait que chaque réseau de neurones artificiels gérant une tâche cruciale puisse avoir une forme de conscience du caractère faillible de ses résultats en modélisant cette incertitude.

« J’y travaille » confie Gianni Franchi, sans vouloir révéler pour le moment sur quelles pistes il réfléchit, car il compte les présenter lors de la prochaine édition de la Conférence internationale sur les représentations d'apprentissage (ICLR) de 2024. « Le taux d’acceptation des papiers est très bas, de l’ordre de 20%. Et dans les papiers qui sont acceptés, 60% proviennent de groupes qui disposent de moyens beaucoup plus importants que les nôtres… Mais comme vient de le démontrer l’acceptation de notre papier par l’ICLR de 2023, les travaux novateurs parviennent tout de même à percer. Il faut faire preuve de créativité. »

Un jour, pour plus d’impartialité, ce seront peut-être des intelligences artificielles qui décideront des sujets retenus dans ce genre de conférence. Gageons alors que ce jour-là, les travaux de Gianni Franchi auront doté les réseaux de neurones de suffisamment d’esprit critique pour donner un reflet plus équitable de la réalité de la recherche académique sur l’intelligence artificielle.